ปิติคุณ นิลถนอม

ความขัดแย้งของรัสเซียและยูเครนที่นำไปสู่สงครามทำให้แต่ละประเทศต่างเฝ้าระวังโดยเฉพาะประเทศในยุโรปที่เป็นสมาชิกนาโต้ รวมถึงประเทศที่มีพรมแดนติดกับประเทศยูเครนและรัสเซีย

ในขณะที่ประเทศอื่นๆ ในประชาคมโลกก็เป็นห่วงสถานการณ์ดังกล่าวอยู่ไม่น้อย เพราะแน่นอนการรบพุ่งที่เกิดขึ้นนั้นย่อมทำให้เกิด supply shock ซึ่งที่เห็นได้ชัดเจนเลยคือรัสเซียเป็นผู้ส่งออกน้ำมันดิบรายใหญ่ลำดับที่ 3 ของโลก ในขณะที่ยูเครนก็เป็นผู้ส่งออกข้าวโพดลำดับที่ 6 ของโลกเช่นกัน นี่เป็นเพียงการมองอย่างเร็วๆ ซึ่งจริงๆ แล้วส่งผลกระทบในวงกว้างกว่านั้นมาก โดยเฉพาะในระยะยาวที่นักวิเคราะห์บางคนเห็นว่าประเทศต่างๆ ย่อมมีแนวโน้มที่จะเพิ่มงบประมาณด้านความมั่นคงและการทหารมากขึ้นจากวิกฤติครั้งนี้ นั่นย่อมหมายความว่าเม็ดเงินจำนวนมหาศาลที่ควรจะถูกนำไปใช้จ่ายเพื่อส่งเสริมให้เกิดคุณภาพชีวิตที่ดีต่อประชาชนและการพัฒนาที่ยั่งยืน ก็ย่อมถูกโยกไปใช้ในวัตถุประสงค์ด้านความมั่นคงด้วย ทำให้การพัฒนาที่ควรจะเป็นไปตามครรลองย่อมถูกกระทบอย่างมีนัยสำคัญ

นอกเหนือจากต้นทุนของสงครามและผลกระทบในระยะยาว เมื่อมองสิ่งที่เกิดขึ้นเฉพาะหน้านี้ก็เป็นภาพที่สลดหดหู่ โดยเฉพาะภาพความเสียหายของตึกรามบ้านช่อง สิทธิมนุษยชนที่ถูกละเมิด การโจมตีเป้าหมายที่ไม่ใช่ทางทหาร ส่งผลให้ภาพข่าวที่ออกมานั้นน่าเศร้าใจยิ่งนัก และไม่น่าเชื่อว่าจะเป็นสงครามที่เกิดขึ้นในศตวรรษที่ 21 นี้

เมื่อสิ่งที่ไม่คาดคิดมาเกิดขึ้นในยุคดิจิทัลเช่นนี้แล้วภูมิทัศน์ของสงครามเลยมีความแตกต่างจากสงครามในอดีต แน่นอนการใช้ข้อมูลข่าวสารในการต่อสู้กันเป็นเรื่องปกติ แต่ปัจจุบันมีเทคโนโลยีข้อมูลข่าวสารที่สื่อสารกันอย่างรวดเร็วผ่านโลกอินเทอร์เน็ต ก็ย่อมทำให้คู่ขัดแย้งและพันธมิตรใช้เป็นเครื่องมือในการดำเนินการให้บรรลุวัตถุประสงค์ของตนแบบ real time ดังจะเห็นได้จากการใช้การทูตทวิตเตอร์ หรือ twiplomacy ในการโจมตีฝ่ายตรงข้ามผ่านการโฆษณาชวนเชื่อ ที่น่าสนใจคือฝั่งยูเครนมีการใช้ทวิตเตอร์ในการร้องขอความช่วยเหลือจากต่างชาติ ซึ่งแน่นอนได้รับการตอบสนองอย่างรวดเร็ว ดังจะเห็นได้จากกรณี Mykhailo Fedorov รองนายกรัฐมนตรีและรัฐมนตรีว่าการกระทรวงปฏิรูปดิจิทัล ขอใช้บริการอินเทอร์เน็ตดาวเทียมสตาร์ลิงก์จาก Elon Musk และได้รับการตอบสนองในทันที

นอกเหนือความเคลื่อนไหวและท่าทีของบุคคลที่มีตำแหน่งแห่งที่ในรัฐบาลของคู่ขัดแย้งรวมถึงพันธมิตรแล้ว ในมุมของการนำเสนอข่าวสารนั้น สื่อมวลชนทั่วโลกต่างรายงานข่าวกันอย่างแข็งขัน รวมถึงประชาชนคนธรรมดาอย่างเราๆ ที่มีโทรศัพท์มือถือและเข้าถึงสัญญาณอินเทอร์เน็ต ก็ทำหน้าที่เป็นผู้สื่อข่าวที่สามารถส่งข้อมูลต่างๆ เข้าสู่ระบบสังคมออนไลน์ให้ชาวโลกได้เห็น แม้กระทั่งทำหน้าที่เป็นผู้สื่อข่าวรายงานสดจากสถานที่เกิดเหตุจริงๆ

แต่ปัญหาที่เกิดขึ้นท่ามกลางข้อมูลมหาศาลนี้คือ ข้อมูลใดบ้างที่เป็นข้อมูลจริง ข้อมูลใดคือข้อมูลเท็จ เพราะการสื่อสารข้อมูลออกไปแม้จะไม่มีเจตนาแต่ภาษาที่ใช้ หรือมุมกล้องที่ถ่าย ก็อาจทำให้เข้าใจผิดได้ ซึ่งรวมถึงผู้ที่เชื่อโดยสุจริตแล้วส่งต่อข้อมูลนั้นด้วย (misinformation) นับประสาอะไรกับผู้ที่ต้องการบิดเบือนข้อเท็จจริงก็ย่อมสามารถเติมแต่ง ใส่สีตีไข่ลงไป (disinformation) รวมถึงเผยแพร่ข่าวปลอม (fake news) ได้โดยง่าย

ปรากฏการณ์ของข่าวสารที่ถูกบิดเบือนในช่วงนี้สอดคล้องกับคำกล่าวของ Hiram Johnson อดีตผู้ว่าการรัฐแคลิฟอร์เนีย ที่ว่า เมื่อสงครามเกิดขึ้นคนเจ็บตัวคนแรกคือความจริง – “The first casualty when war comes is truth”

หลังเกิดความขัดแย้งของรัสเซียและยูเครน การส่งต่อข้อมูลที่คลาดเคลื่อนที่เห็นได้ชัดก็น่าจะเป็นกรณีที่รายการข่าวของสำนักข่าวใหญ่แห่งหนึ่งได้นำเสนอข่าวโดยใช้ข้อมูลที่ส่งต่อๆ กันในโลกออนไลน์ว่ายูเครนสร้างข้อมูลเท็จกรณีอ้างว่ามีคนตายจากการรุกรานของรัสเซีย โดยกล่าวหาว่าสิ่งที่อยู่ในถุงดำใส่ศพนั้นเป็นคนที่ยังไม่ตาย

แต่ที่ไหนได้ ภาพข่าวดังกล่าวเป็นภาพข่าวของสำนักข่าว OE24 ที่นำเสนอภาพการประท้วงเรื่องโลกร้อนในกรุงเวียนนา ประเทศออสเตรีย ซึ่งหากไปตรวจสอบต้นตอของคลิปเจ้าปัญหาที่เป็นคลิปเต็มแล้ว ก็จะทราบได้ว่ามันไม่ใช่เหตุการณ์ในยูเครนเลย เพราะข่าวดังกล่าวมีตัวอักษรขึ้นว่า Wien ซึ่งเป็นภาษาเยอรมันหมายถึงกรุงเวียนนา

อย่างไรก็ตาม บรรดาแฟนานุแฟนที่เชื่อในเนื้อหาของข่าวปลอมนี้เพราะถูกจริต เนื่องจากมีใจโอนเอนเข้าข้างทางฝ่ายใดฝ่ายหนึ่งอยู่แล้ว ก็มีตัวเร่งจากอคติที่เรียกว่า confirmation bias จนทำให้เกิดสภาวะ “มือลั่น” ส่งต่อไปอย่างกว้างขวาง โดยไม่ตรวจสอบ เป็นผลให้เกิดความสับสนในสังคมไปกันใหญ่

คลิปเจ้าปัญหาที่แท้จริงแล้วเป็นภาพข่าวการประท้วงเรื่องโลกร้อนในประเทศออสเตรีย ไม่เกี่ยวกับสงครามรัสเซีย-ยูเครนเลย ที่มาภาพ: https://www.oe24.at/video/news/wien-demo-gegen-klimapolitik/509553935

ทั้งนี้ หากพิจารณาดูข่าวปลอมนี้ ก็ถือได้ว่าเป็นการปลอมแบบไม่เนียนต้องเรียนมาใหม่ หรือเรียกว่า cheap fake ซึ่งจริงๆ หากวางอคติลง ไม่ด่วนสรุปและแชร์ออกไป แล้วตรวจสอบดูสักนิดก็จะรู้ได้ไม่ยากว่ามันไม่จริง

ดูแหล่งที่มา ไม่ดูแค่พาดหัว ดูความน่าเชื่อถือของผู้เขียน แสวงหาหลักฐานสนับสนุน ตรวจสอบวันที่ ดูเจตนาผู้เขียนว่าจงใจทำเพื่อล้อเลียนหรือไม่ การเตือนตนเองให้ระวังอคติ การถามผู้เชี่ยวชาญ นำภาพไปค้นหาโดยใช้ serch engine หรือใช้บริการเว็บเพจที่ทำหน้าที่ตรวจสอบข่าวปลอม เป็นวิธีง่ายๆ ในการไม่ตกเป็นเหยื่อของข่าวปลอม

แต่สิ่งที่น่ากลัวคือข่าวปลอมที่แนบเนียนหรือที่เรียกว่า deepfake ที่ใช้เทคโนโลยีชั้นสูง อย่างปัญญาประดิษฐ์หรือ AI ในการบิดเบือนข้อมูลอย่างสมจริง โดยเฉพาะการสร้างให้คนมีชื่อเสียงพูดในสิ่งที่ผู้กระทำต้องการ

ในสถานการณ์ความขัดแย้งของยูเครนและรัสเซียก็มีการใช้ข่าวปลอมลักษณะนี้ในการโจมตีฝั่งตรงข้าม เช่น กรณีการใช้ AI สร้างอวาตาร์ของ Volodymyr Zelenskyy ประธานาธิบดียูเครน เพื่อให้กล่าวประกาศยอมแพ้

คลิปวิดีโอ deepfake ที่สร้างให้ Volodymyr Zelenskyy ประธานาธิบดียูเครนประกาศยอมแพ้ และต่อมามีการลบออกไป ที่มาภาพ: https://nypost.com/2022/03/17/deepfake-video-shows-volodymyr-zelensky-telling-ukrainians-to-surrender/

deepfake ลุกลามมาถึงการหลอกลวงของแก๊งคอลเซนเตอร์ ที่จากเดิมใช้วิธีการโน้มน้าวโดยการพูดข่มขู่ หรือหลอกลวงมาเป็นการใช้แอปพลิเคชันสร้างภาพเจ้าหน้าที่ตำรวจใส่เครื่องแบบและขยับปากพูดตามเสียงปลายสายที่ดูคล้ายกับเจ้าหน้าที่คนนั้นพูดอยู่จริงๆ เพื่อหลอกให้เหยื่อหลงเชื่อว่าคนที่กำลังวิดีโอคอลกับตนเป็นเจ้าหน้าที่ตำรวจตามที่มิจฉาชีพกล่าวอ้าง

ในประเด็นนี้องค์กรตรวจเงินแผ่นดินสหรัฐอเมริกา หรือ U.S. Government Accountability Office ได้ทวีตข้อความเมื่อวันที่ 18 มีนาคมที่ผ่านมา หลังปรากฏกรณีการตัดต่อภาพวีดีโอของประธานาธิบดี Zelenskyy ที่ผู้เขียนกล่าวถึงข้างต้น โดยได้เผยแพร่ผลการศึกษาและวิธีการตรวจสอบข่าวปลอมที่เป็น deepfake ว่าจะสังเกตและ “จับไต๋” ได้อย่างไร

ในรายงานฉบับดังกล่าวอธิบายว่า deepfake คือภาพวิดีโอ รูปถ่าย หรือไฟล์เสียง ที่ทำให้เหมือนจริงผ่านปัญญาประดิษฐ์ ที่ถูกสอนให้จดจำข้อมูลและรูปแบบต่างๆ ซึ่งใช้เทคโนโลยีอย่าง autoencoders และ generative adversarial networks (GANs)

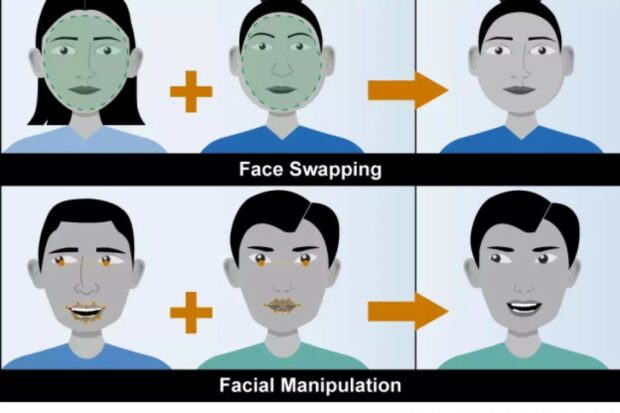

กระบวนการนี้สามารถเปลี่ยนหน้า ปรับแต่งรูปหน้า เพื่อสร้างให้บุคคลใดพูดในสิ่งที่บุคคลนั้นไม่เคยพูดเลยได้ ซึ่งอาจแบ่งได้เป็น 2 วิธี คือ การสลับหน้าไปเลย (face swapping) โดยนำหน้าของนาย ก มาใส่แทนหน้าของนาย ข ส่วนอีกวิธีคือการบิดเบือนหน้า (face manipulation) โดยการนำการแสดงออกทางสีหน้าแววตาและรูปปาก ไปใส่ในหน้าของบุคคลอื่น เพื่อให้บุคคลนั้นแสดงสีหน้าแววตาและพูดในสิ่งที่ต้องการ

ภาพแสดงวิธีการสลับหน้า (face swapping) และวิธีคือการบิดเบือนหน้า (face manipulation) ที่มาภาพ: https://www.gao.gov/products/gao-20-379sp?utm_source=twitter&utm_medium=social&utm_campaign=gpi

รายงานอธิบายต่อไปว่า deepfake มักจะใช้ในสื่อที่เกี่ยวข้องกับสื่อลามก ซึ่งผู้หญิงมักตกเป็นผู้เสียหาย นอกจากนี้ยังมีการใช้เพื่อประโยชน์ในการบิดเบือนข้อมูลข่าวสาร การสร้างข่าวปลอม การสร้างกระแสการเลือกตั้ง การก่อให้เกิดความไม่สงบในสังคม รวมถึงการใช้เป็นเครื่องมือในการทำสงครามจิตวิทยา (psychological warfare) ซึ่งส่งผลเสียอย่างร้ายแรง โดยเฉพาะการทำลายความเชื่อมั่นสาธารณะหรือ public trust

อย่างไรก็ตาม ในอีกมุมหนึ่งก็มีประโยชน์อยู่บ้างบางประการ เช่น ในวงการบันเทิง การที่สามารถใช้หน้าดาราไปใส่แทนหน้าผู้อื่นในกรณีที่นักแสดงไม่สามารถทำการแสดงได้ เช่น ไม่สบายหรือเป็นฉากเสี่ยงตาย หรือในกรณีการซื้อขายสินค้าออนไลน์ที่ทำให้ลูกค้าสามารถนำหน้าของตนไปใส่ในภาพบุคคลอื่นเพื่อประกอบการตัดสินใจในการซื้อเสื้อผ้า เป็นต้น

รายงานระบุต่อไปว่า คนทั่วไปที่มีความรู้เกี่ยวกับคอมพิวเตอร์ที่ใช้กันโดยปกติก็สามารถสร้าง deepfake ได้ โดยใช้โปรแกรมหรือแอปพลิเคชันที่มีให้ดาวน์โหลดกันอยู่ทั่วไป จึงเป็นสิ่งที่น่ากลัวมากหากใช้ในวัตถุประสงค์ที่ไม่ถูกต้อง

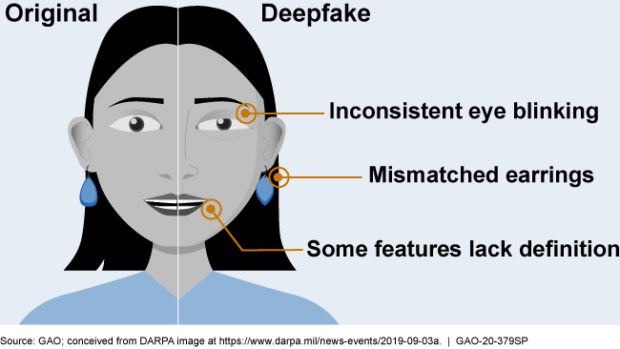

ดังนั้นจึงมีความสำคัญมากในการที่จะสังเกตสังกาบรรดาข้อมูลข่าวสารที่รับมา ก่อนที่จะเชื่อและส่งต่อเสมอ โดย GAO ได้อธิบายวิธีการจับไต๋ deepfake ลักษณะนี้ว่า ในบางกรณีที่มีความแนบเนียนและใช้เทคโนโลยีชั้นสูงมากในการทำ อาจจำเป็นต้องใช้ AI ในการจับผิด ทำนองหนามยอกเอาหนามบ่ง เช่น Microsoft และ Intel ได้เปิดตัวเครื่องมือในการตรวจสอบมาตั้งแต่ปี 2020 แต่ในสถานะประชาชนคนธรรมดาที่มีความรู้เกี่ยวกับคอมพิวเตอร์ที่ใช้กันโดยปกติทั่วไปก็สามารถสังเกตได้ ด้วยวิธีง่ายๆ เช่น การสังเกตการกะพริบตาที่ผิดธรรมชาติ รูปปากที่ไม่เป็นธรรมชาติในเวลาพูด ต่างหูที่ไม่เข้าคู่กัน เป็นต้น

การกะพริบตาที่ผิดธรรมชาติ ต่างหูที่ไม่เข้าคู่กัน รูปปากที่ผิดปกติในเวลาพูด รูปหน้าที่ผิดธรรมชาติ เป็นตัวอย่างง่ายๆ ในการจับผิด deepfake ที่มาภาพ : https://www.gao.gov/products/gao-20-379sp?utm_source=twitter&utm_medium=social&utm_campaign=gpi

ในขณะที่เขียนบทความอยู่นี้ สถานการณ์ความขัดแย้งของยูเครนและรัสเซียยังคงตึงเครียดอยู่ ได้แต่หวังว่าสถานการณ์จะคลี่คลายไปในทางที่ดีในเร็ววัน ซึ่งสถานการณ์ที่มีข่าวสารอัปเดตจำนวนมหาศาลในแต่ละวัน การเสพสื่ออย่างมีสติและลดอคติลงบ้าง ไม่ว่าจะลำเอียงเพราะ รัก โกรธ หลง หรือกลัว ก็น่าจะทำให้เห็นอะไรมากขึ้น เข้าอกเข้าใจมากขึ้น มีความเป็นมนุษย์มากขึ้น ทำให้มีสติในการคิดก่อนที่จะแชร์ต่อมากขึ้นตามไปด้วย

นอกจากนี้ ความรู้เท่าทันเทคโนโลยีสมัยใหม่ (digital literacy) อย่าง AI ที่นำมาบิดเบือนข้อมูลแบบ deepfake นอกจากจะเป็นภูมิคุ้มกันที่ทำให้แยกแยะข่าวจริงข่าวปลอมออกแล้วยังถือเป็นเกราะป้องกันการถูกหลอกลวงจากพวกแก๊งคอลเซนเตอร์ที่หาวิธีใหม่ๆ มาหลอกเราได้ทุกเมื่อเชื่อวันอีกด้วย

ข้อมูลประกอบการเขียน

Oil Production by Country – Worldometer (worldometers.info)

World Corn Production: Ranking of Countries (USDA) – Beef2Live | Eat Beef * Live Better

https://www.tnnthailand.com/news/tech/106292/

https://guides.lib.umich.edu/c.php?g=283063&p=4471741

https://www.standard.co.uk/news/world/ukraine-russia-war-how-spot-fake-news-misinformation-fact-check-sources-b988226.html

https://foreignpolicy.com/2022/03/08/ukraine-propaganda-war/

https://www.oe24.at/video/news/wien-demo-gegen-klimapolitik/509553935

https://nypost.com/2022/03/17/deepfake-video-shows-volodymyr-zelensky-telling-ukrainians-to-surrender/https://www.pptvhd36.com/news/%E0%B8%AD%E0%B8%B2%E0%B8%8A%E0%B8%8D%E0%B8%B2%E0%B8%81%E0%B8%A3%E0%B8%A3%E0%B8%A1/167834

https://twitter.com/USGAO/status/1504557186550226947?t=mbNIMXHLka1f68jDJ3mjxQ&s=19

https://www.gao.gov/products/gao-20-379sp?utm_source=twitter&utm_medium=social&utm_campaign=gpi